Nach wochenlangem Testen und Werken möchte ich hier die Details zu ElsterOnline – dem Portal zur elektronischen Steuererklärung – in Verbindung mit einer Smartcard beschreiben, um sozusagen „vorwärts“ zu kommen.

Was alles nicht funktioniert, hat definitiv einen hohen Unterhaltungswert. Ich möchte mich aber auf das „wie funktioniert es“ beschränken.

Vorab: die Sache ist nicht einfach und Elster wendet sich hier an die erfahrenen IT-User. Vermutlich für Firmen, deren Administratoren das erledigen können. Da ich sicherheitsinteressiert bin, schon eltiche Jahre Kartenleser einsetze, asymetrisch verschlüssle und mich (ja, meine Frau auch, sie hat auch viele Stunden mit Elster und dem Kartenleser verbracht) auf solche Herausforderungen einlasse, haben wir uns NICHT für den USB-Stick, sondern für die Karte entschieden. Der USB-Stick ist einfacher zu implementieren. Hier kenne ich aus eigener Erfahrung im Job Probleme mit dem 32bittigen JAVA auf 64-Bit-Maschinen. Gebastel. Hat aber funktioniert.

Also: hier zum Weg, wie ich eine Signaturkarte der Bundesdruckerei mit Elster zum Laufen bekommen habe.

1.) Bei einem Dienstleister – z.B. der Bundesdruckerei – eine Smartcard erwerben.

Die Bundesdruckerei ist ein Dienstleister rund um das Thema Identifikation und Authentisierung. Es ist eine staatliche GmbH und druckt auch Geldnoten. Zudem gibt es eine 100%ige Tochter, die D-Trust GmbH. Als ein von der Bundesnetzagentur akreditiertes Unternehmen bietet D-Trust Dienstleistungen rund um digitale Signaturen an. Dort bekommt man also eine Signaturkarte mit einer qualifizierten elektronischen Signatur. Mit dieser Art von Signatur kann man Geldgeschäfte erledigen, sie gilt gleichwertig mit der eigenen Unterschrift. Dafür sind einige Vorarbeiten notwendig. Zudem ist es nicht entscheidend, welches Trustcenter man sich aussucht. Auch die Sparkasse oder DATEV bieten ähnliche Dienstleistungen an. Es beginnt also mit dem Besuch der Bundesdruckerei per Webseite. Das Produkt nennt sich „D-Trust card“. Die Karte beinhaltet zwei Dateien: eine Datei – also ein Schlüssel – mit dem man Daten sicher verschlüsseln kann und eine Datei, mit der man Dokumente signieren, also unterschreiben kann. Die Beantragung erfolgt auf der Webseite. Anschließend bekommt man über die Seite ein Dokument (ein Ausdruck, also z.B. ein PDF) mit Dokumenten, die man zu D-Trust nach Berlin senden muss, z.B. die Kopie des Personalausweises, etwaige Unterlagen über Titel, die auf der Karte geführt werden sollen. Das geschieht per Postident auf einem Postamt in Ihrer Nähe, damit zu einem Zeitpunkt sicher gestellt werden kann, dass der Antragsteller auch die Person ist, die letztlich auf der Karte hinterlegt ist. D-Trust informiert regelmäßig über den Stand des Antrages. Danach kommt die Karte und einige Tage später die PINs für die Karte. Das ganze dauert ca. 2 Wochen. Eine Empfangsbestätigung muss umgehend zurückgesendet werden, da sonst nach 2 Wochen das Zertifikat als ungültig erklärt werden kann. Man kann sich nämlich auf der Homepage erkundigen, ob ein Zertifikatsinhaber ein gesperrtes oder gültiges Zertifikat besitzt. Bei der Bestellung sollte gleich die D-Trust Personalsuite mit erworben werden. Darauf befindet sich D-Trust nexus personal, eine Middleware zwischen Elster und dem Kartenleser. Trifft die Karte ein, muss sie mit einer Software in Betrieb genommen werden, die von D-Trust wenige Tage vorher per Mail-Link heruntergeladen worden ist (D-TRUST_Card_Assistant.exe). Die Beschreibung zu diesen Schritten ist klar von D-Trust vorgegeben.

2.) Elster vorbereiten

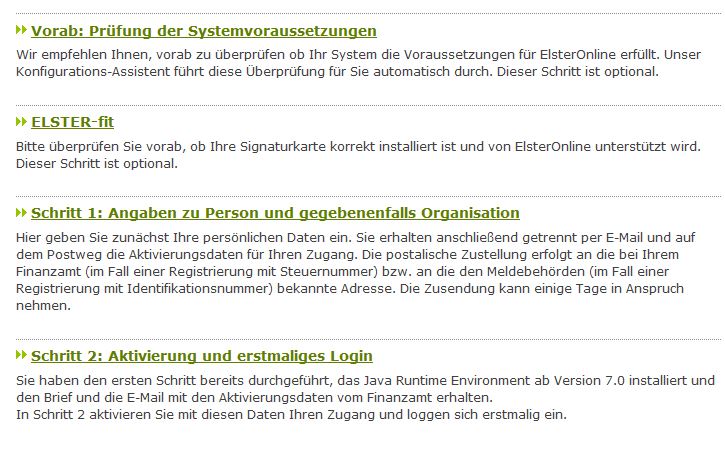

Derweilen kann über Elster (https://www.elsteronline.de/eportal/Oeffentlich.tax) die Registrierung eines Zugangs angestoßen werden. Das ganze nennt sich „Elster Plus“. Elster warnt bereits auf der Webseite, dass die Bedienung komplex ist. Man beginnt mit Schritt 1 „Angaben zur Person und Organisation“ und registriert sich mit einer persönlichen Registrierung mit Identifikationsnummer. Die Finanzverwaltung sendet darauf hin einen Aktivierungscode zu, der zusammen mit der bei der Registrierung erstellten Benutzerkennung später notwendig ist. Punk 4. Dauer ebenfalls ca. 1 bis 2 Wochen.

2.) Ein System vorbereiten (Stand 17.04.15)

Das war in der Tat der schwierigste Punkt. Bei mir funktioniert ein unter VMWare (per Player) installiertes Windows XP Pro Sp3, kann voll gepatchet sein. Darauf die Java Version 1.8.U45, ein Firefox Version 37 sowie ein Reiner Smartcard Leser mit für XP aktuellen Treibern von der Homepage. Ein anderer Unterbau hat nicht funktioniert. Windows 7 Home Premium 32 Bit, die Pro-Version mit 64 Bit – nichts. Nur XP hat funktioniert. Zudem muss die Middleware D-Trust nexus personal von der mitgelieferten CD (hier Version 4.24.2) installiert werden. Prinzipiell habe ich ein aktuelles XP oder besser: ein XP, das nicht aktueller sein kann (irgendwann läuft Java oder FF nicht mehr mit aktuellen Versionen) unter der Warnung, dass XP nicht mehr eingesetzt werden sollte. Vergessen Sie nicht den Virenscanner zu installieren und zu aktivieren. Zudem darf sonst nichts mit dem System gemacht werden. Arbeiten Sie NICHT mit diesem System im Produktiveinsatz. Öffnen Sie im Browser NUR Elster, sonst nichst. Wenn Sie sich einen Schädlich einfangen, weil das System nicht mehr supportet wird, dann bringt das ganze Sicherheitsgetue nichts. Die Daten gehen aus Ihrem System! Dauer: 1 bis 2 Stunden.

3.) Das System konfigurieren.

Die Signaturkarte wird zunächst in den Kartenleser eingelegt. Dann geht es um die Datei personal.dll, welche über die Middleware nexus personal auf die Platte kommt. Diese Datei managed zwischen Kartenleser, d.h. Zertifikat und der Webseite, d.h. dem Java Plugin auf der Elster-Webseite. Der Weg zu dieser Datei auf der Platte muss den path-Umgebungsvariablen hinzugfügt werden. (C:\Programme\Personal\bin\). Als zweiten Schritt muss die mit nexus installierte Datei Personal.cfg (C:\Dokumente und Einstellungen\<benutzername>\Anwendungsdaten\Personal\config) editiert werden. Im Notepad geöffnet, muss unter der Rubrik „[firefox.exe]“ das Flag „P11_ShowLoginDialogIfPinPad=1“ eingefügt werden. Dann muss der Firefox-Browser wissen, dass die personal.dll vermitteln kann. Die DLL stellt für den Firefox ein sogenanntes Kryptografie-Modul. Der Browser bringt per Default einige mit, um Webseiten sicher erreichen zu können. Über den Button „laden“ fügt man den Pfad zu der personal.dll hinzu. Dann wird der Firefox beendet und 1x als Administrator gestartet. Jetzt sollte ein Fenster erscheinen, dass ein Zertifikat der Karte in den Zertifikatsspeicher des Browsers hinzugefügt wird. Es werden Details zum Zertifikat angezeigt. Danach kann der Browser wieder beendet werden. Ab jetzt dauert ein Start von Firefox wesentlich länger, da der neue Kryptoprovider hochgefahren/eingebunden/gestartet etc. werden muss.

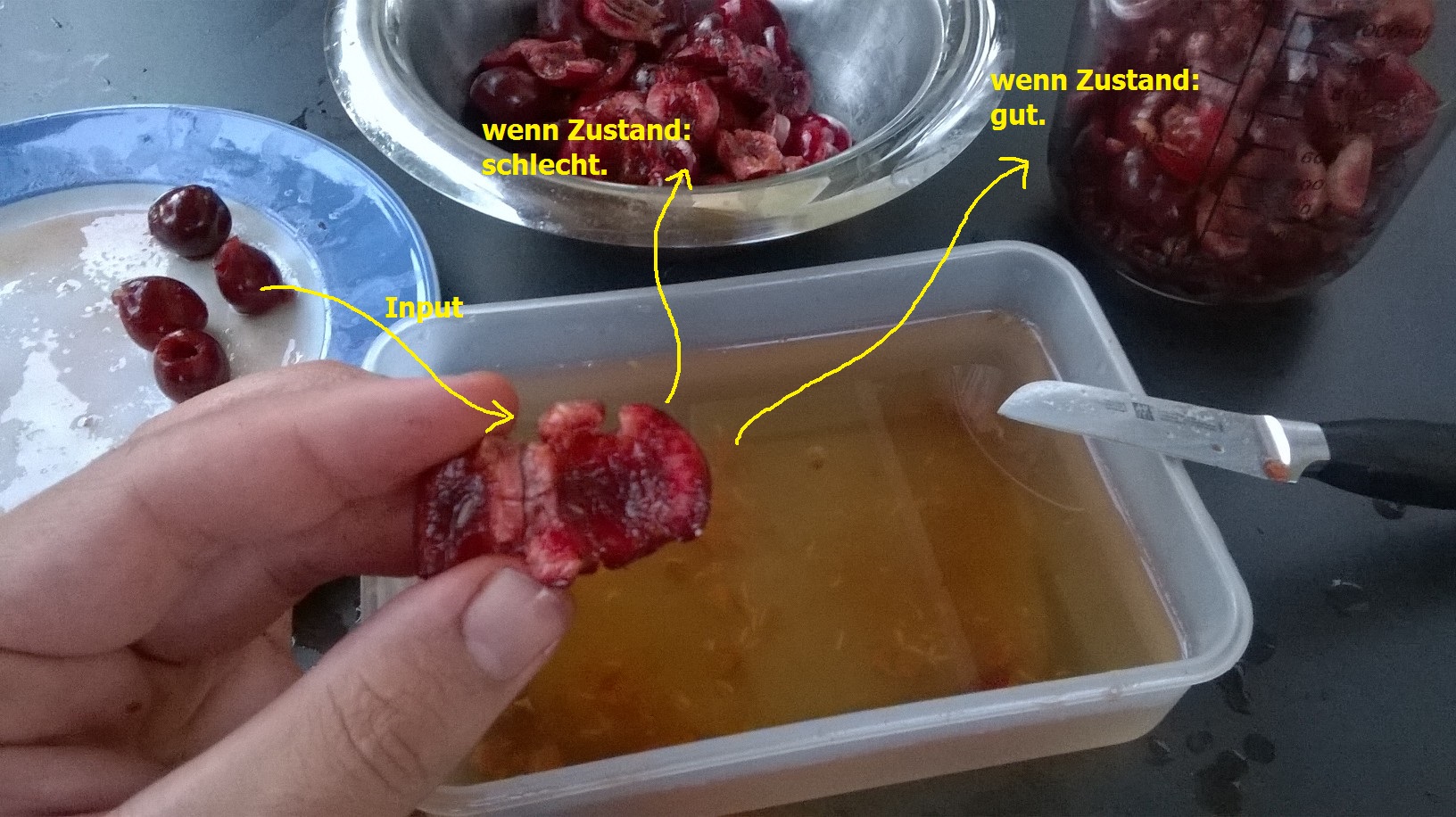

4.) Test der Konfiguration

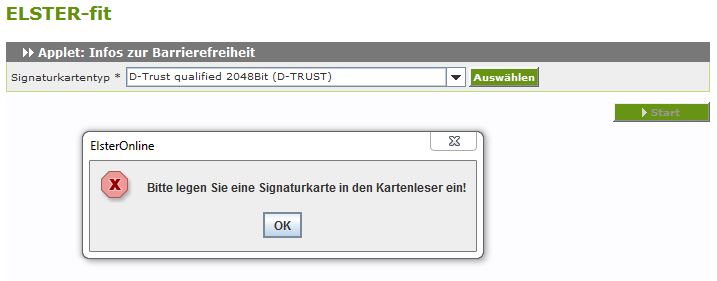

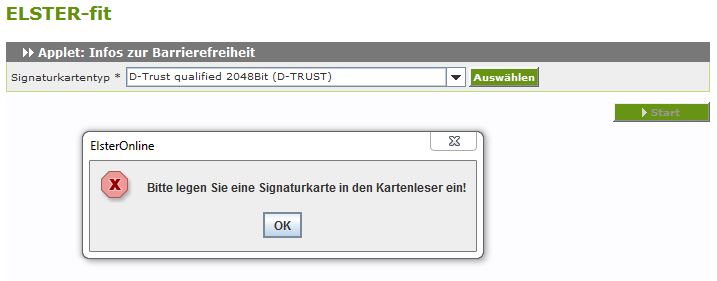

Suchen Sie auf der Elster-Webseite „ElsterFit“ um Ihre Karte mit dem System testen zu können. Aus der Auswahlbox wählen Sie Ihren Typ der Signaturkarte und anschließend „Auswählen“, den grünen Button daneben. So. Und hier gab es laufend die Fehlermeldung: „Bitte legen Sie eine Signaturkarte in den Kartenleser ein.“ Freilich kam ich letztlich zu diesem Post und zu einer Lösung aber. Der Weg führte über etliche Betriebssysteminstalltionen mittels VMWare und ich weiß nicht wie viele Stunden probierens ich damit verbraucht habe. Aber letztlich war die Fehlermeldung weg und mit dem

Bild: Bitte legen Sie eine Signaturkarte in den Kartenleser ein.

Falls es funktioniert, wird eine entsprechende Meldung ausgegeben.

5.) Bestätigung des Aktivierungscodes mit der erstellten Benutzer-ID.

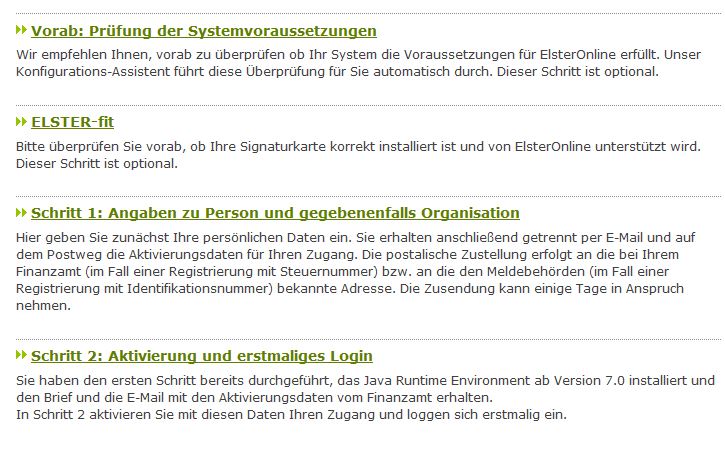

Danach kann über die Elsterseite zum Schritt zwei gesprungen werden: die Aktivierung des Codes mit der erstellten ID.

Bild: Stand 17.04.2015 der Webseiten, machen Sie jetzt Schritt 2.

Bild: Stand 17.04.2015 der Webseiten, machen Sie jetzt Schritt 2.

Im Laufe Schritt 2 wird die Karte sowie verschiedene Parameter geprüft: ist die Karte auslesbar, ist die Karte gesperrt, d.h. hat das Trustcenter die Signatur der Karte deaktiviert (man kann bei D-Trust nachsehen, ob die Signatur auf der Karte sowie die dazugehörigen Daten mit den Informationen in einer signierten Datei z.B. PDF-Datei übereinstimmen). Auch Elster nimmt beim ersten Start Prüfungen vor, ob die Inhalte der Karte mit der Registrierung sowie den Daten bei D-Trust übereinstimmen. Verstreicht zwischen Beantratung der Daten über das Bayerische Landesamt für Steuern und erstmaliger Nutzung über Schritt 2 zu viel Zeit, erscheint die Fehlermeldung: „080090208: Die Verarbeitung des Requests wird aufgrund des aktuellen Status des

Benutzerkontos abgelehnt.“ Dann muss unkompliziert das ganze nochmals in Gang gesetzt werden.

6.) Verwenden.

Über Elster Online kann z.B. die Steuererklärung abgesendet werden. Bei nächster Gelegenheit werde ich hierzu mehr schreiben.

Hier noch ein paar Hiweise, wo Fehler liegen könnten: m.E. war der ausschalggebende Punkt letztlich die Path-Variable. Ich habe in Windows XP über die cmd.exe – die Kommandozeile – die Variable editiert. D-Trust gibt in seinen Beschreibungen vor, dass dies über die grafische Oberfläche in der Systemsteuerung zu erledigen ist. Ja, ich weiß: das sollte identisches Ergebnis folgen. Aber das war der einzige Punkt, den ich zwischen „Funktioniert nicht“ und „Jetzt funktioniert es“ erledigt habe. Andere Webseiten u.a. das Elster-Forum geben spezielle Java-Versionen an. Hierzu kann ich sagen, dass das für XP aktuellste Gespann aus Java und Firefox funktioniert hat. Windows 7 als 32 oder 64 Bit habe ich überhaupt nicht zum Laufen bekommen. Dann könnte der fehlende Start des FF als Admin eine Fehlerquelle sein. Dann habe ich auf diversen Webseiten gelesen, dass das oben beschriebene Flag „P11_ShowLoginDialogIfPinPad=1“ in der Rubrik „[iexplore.exe]“ eingefügt wurde, obwohl die Blogger Firefox verwendet haben. Dann muss nexus in Form laufen, ersichtlich über ein rot-weißes Icon im Try. Dieses arbeitet, wenn eine Signaturkarte im Leser eingelegt wird. Dann kommt das Elster-Plugin im Browser NICHT damit klar, wenn die virtuelle Maschine in den Suspend-Mode gesetzt wird – ist mir auch passiert. Plötzlich hätte ich eine falsche Java-Version, die von Elster-Online nicht unterstützt wird. Ein Neustart schaffte Abhilfe. Dann kann die virtuelle Maschinen NICHT den Kartenleser einbinden, wenn auf dem darunterliegenden Host-System die Middleware läuft bzw. das personal.dll-Modul in den Browser eingebunden ist: also entfernen.

Ich hoffe, dass ich dem einen oder anderen verzweifelten User helfen konnte. Jaja, ich rede mich leicht: Wieso funktionieren aktuelle Systeme nicht? Warum muss hier ein unsicheres Xp für die sichere Übertragung von Steuerdaten verwendet werden? Das Hauptproblem sehe ich mit 64bittigen Systemen, in denen 32-Bit-Kompoenten laufen sollen: Browser samt Authentifizierung, dann noch das Java dazu, dann die Kartentreiber, dann die Middleware. Wir haben hier eine Handvoll Komponenten, die aufgrund von Standards zusammenarbeiten müssten oder müssen. Das ist schwierig genug. Eine All-In-One-Lösung gibts nicht. Ich würde einen Elster-Thick-Client bevorzugen, wenn es einen gäbe, d.h. die Installationsversion.

Noch ein paar Worte für die Verwendung der Authentifizierung. Alles, was ich oben beschrieben habe, gehört zur Authentifizierung, also: um dem Finanzamt zu sagen, dass man die Daten über Karte absichern möchte.

Wurde die Registrierung so durchgeführt, folgt noch die eigentliche Aufgabe: die Übermittlung der Steuererklärung. Dafür muss Elster zusammen mit Nexus Personal auf einem PC installiert werden. Im eigenen Falle klappte das mit einem Windows-7-PC. Während der Übertragung musste einige male die personal.dll gewählt werden. Letztlich klappte aber der Prozess, wenn man sich an die Anweisungen in Elter gehalten hat. Viel Spaß damit.

So long.

Weitere Quellen:

https://www.d-trust.net/fileadmin/dokumente/Service-Dokumente/Elster-Online_Internet_Explorer_und_NexusPersonal_V1.0.pdf

https://www.elster.de/anwenderforum/showthread.php?41647-Elsterfit-Meldung-Bitte-legen-Sie-eine-Signaturkarte-in-den-Kartenleser-ein&highlight=legen

https://www.elster.de/anwenderforum/archive/index.php/t-40353.html